Kommer inte att återinföra @OpenledgerHQ, om du har varit uppmärksam får du redan visionen. Om du inte har gjort det, följ upp med inlägget nedan 👇

Men här är vad de flesta fortfarande inte har insett:

Det här är inte bara någon "Web3 AI-gård" med gimmicks.

@OpenledgerHQ håller på att i tysthet lösa kärnproblemet med AI idag: modellanpassning med verkliga incitament.

Tänk på det...

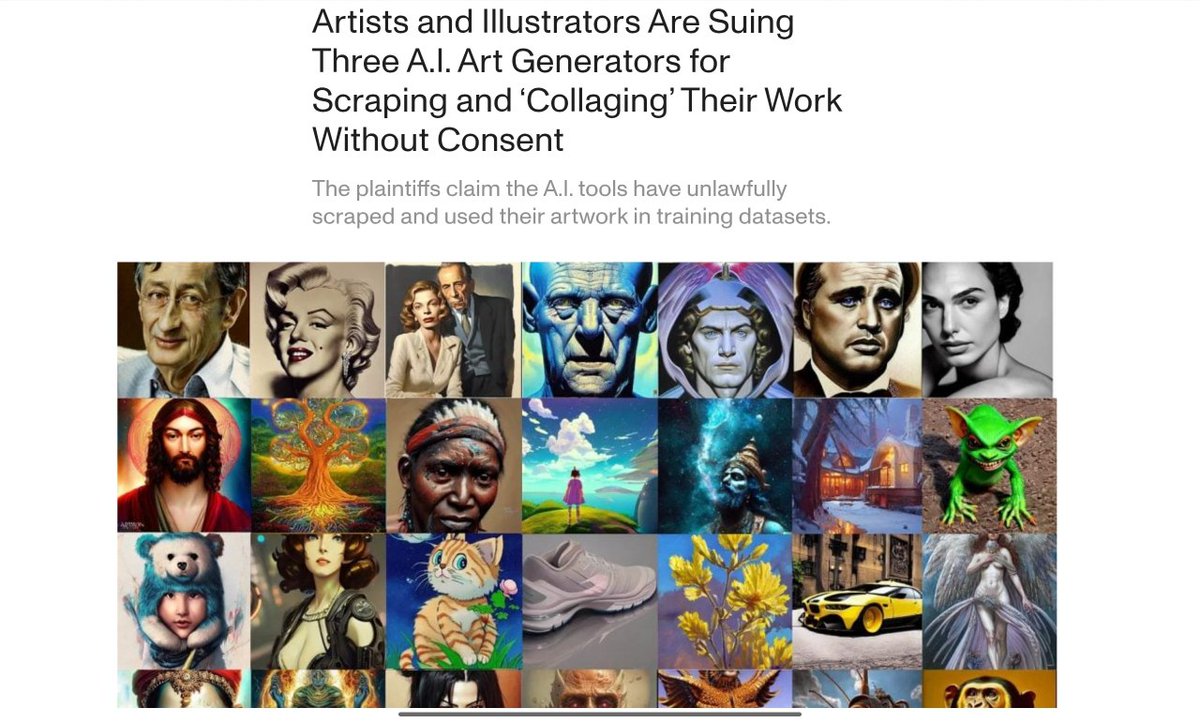

AI bygger idag på data som hämtats från personer som aldrig valt att delta och aldrig fått betalt.

Och sedan producerar det saker som du inte kan granska, inte kan spåra och definitivt inte kan tjäna pengar på om du inte är Big Tech.

Det är därför det varje vecka kommer en ny rättegång, inte för att AI är dåligt, utan för att systemet är trasigt vid källan.

OpenLedger fixar inte bara det.

Den bygger ett protokoll där:

▸ Attribution är standard

▸ Belöningarna är automatiska

▸ Och ju mer användbar din data är, desto mer tjänar du

Vad GitHub gjorde för utvecklare av öppen källkod, gör OpenLedger för bidragsgivare av öppna data.

Du laddar upp, finjusterar, frågar eller till och med bara kurerar.

Systemet hanterar attribution, spårar modellanvändning och betalar ut till dig.

Allt på kedjan. Inga mellanhänder.

Det här är den del som de flesta sover på > du behöver inte vara AI-forskare för att delta.

Du kan bygga datamängder, skapa logik, optimera utdata och ändå tjäna pengar.

Om du bara är här för Kaito- eller Cookie-incitament är det bra.

Men den riktiga alfan?

OpenLedger bygger rälsen för en ny AI-ekonomi, en där protokollet vet vem som bidragit med vad och värdet flödar därefter.

Om nästa miljarddollarmodell tränas på kedjan kommer det att vara för att det här systemet gjorde det möjligt.

Bidrag → tillskrivning → belöning.

Det är inte jordbruk.

Det är grunden.

Vi har fått språkmodeller att låta som magi, men ingen vill prata om de röriga, hemlighetsfulla pipelines som finns under.

Miljarder datapunkter skrapade. Noll ansvar.

Genererade utdata. Inga kvitton.

Och när AI:n säger något fel, stötande eller direkt plagierat?

Vi rycker på axlarna. "Modellen lärde sig det någonstans."

Problemet har ett namn: Den svarta lådan.

Och det börjar kosta oss.

Kommer du ihåg när konstnärer på DeviantArt, ArtStation och Behance upptäckte att deras portföljer användes, utan samtycke, för att träna AI-bildmodeller?

Hela konststilar kopieras. Signaturer förvrängda. Kommersiella produktioner som såg kusligt identiska ut med originalverk.

Tusentals kreatörer lämnade in petitioner, gick med i grupptalan och krävde reglering.

Deras fråga var enkel: "Var har modellen fått det här ifrån?"

Men svaret var grumligt.

För sanningen är att de flesta AI-företag inte kan förklara vilka data som formade vilket resultat. Träningspipelines är ogenomskinliga avsiktligt. Inga loggar. Ingen tillskrivning. Inget ägande.

Det är det som bryter ner förtroendet och kväver ansvarstagandet.

Men vad skulle hända om vi byggde AI på ett annat sätt?

Tänk om vi kunde spåra varje bidrag, belöna data av hög kvalitet och hålla modeller ansvariga, nedifrån och upp?

Det är uppdraget för @OpenledgerHQ, ett decentraliserat AI-nätverk där attribuering är inbyggt i själva protokollet.

Kärnan är något som kallas Proof of Attribution (PoA).

Tänk på det som motsatsen till en svart låda.

PoA säkerställer att varje AI-utdata kan spåras tillbaka till de data som formade den.

Den länkar kryptografiskt träningsdata, modellbeteende och deltagaridentitet, allt lagrat transparent i kedjan.

Det betyder:

» Du kan kontrollera vem som har lagt till vilken data

» Bidragsgivare belönas baserat på effekt

» Skadliga eller lågkvalitativa indata kan straffas

» AI-svar blir tydligare, ett viktigt steg för säkerhet och förtroende

Det @OpenledgerHQ testnätet är redan live, och till skillnad från de flesta är det inte bara en "demo".

Du kan:

▸ Skapa ditt eget Datanet

▸ Finjustera eller interagera med AI-modeller

▸ Spåra vilka data som formade svaren

▸ Hämta belöningar via deras Yapper-topplista

▸ Ingen GPU- eller ML-erfarenhet krävs

Alla interaktioner sker i kedjan. Inget mysterium. Ingen magi. Bara riktig, ansvarsfull AI.

I en tid då stora aktörer är inlåsta i stämningar på flera miljarder dollar och allmänhetens misstro växer, bygger OpenLedger något radikalt annorlunda:

> En framtid där data ägs av samhället.

> En framtid där AI-modeller är öppna, transparenta och granskningsbara.

> En framtid där bidragsgivare inte utnyttjas, utan ges inflytande.

Så medan andra gömmer sig bakom sekretessavtal och slutna vikter, är OpenLedger upptagen med att bevisa den nya standarden.

Det är bara att öppna AI, avsiktligt.

Vill du se den i aktion?

Epok 2 av testnätet är live.

Ingen gatekeeping. Ingen GPU. Bara din nyfikenhet och en plånbok.

ÖPPEN HUVUDBOK 🟠

Transparent AI. Ägs av alla.

1,64 tn

16

Innehållet på den här sidan tillhandahålls av tredje part. Om inte annat anges är OKX inte författare till den eller de artiklar som citeras och hämtar inte någon upphovsrätt till materialet. Innehållet tillhandahålls endast i informationssyfte och representerar inte OKX:s åsikter. Det är inte avsett att vara ett godkännande av något slag och bör inte betraktas som investeringsrådgivning eller en uppmaning att köpa eller sälja digitala tillgångar. I den mån generativ AI används för att tillhandahålla sammanfattningar eller annan information kan sådant AI-genererat innehåll vara felaktigt eller inkonsekvent. Läs den länkade artikeln för mer detaljer och information. OKX ansvarar inte för innehåll som finns på tredje parts webbplatser. Innehav av digitala tillgångar, inklusive stabila kryptovalutor och NFT:er, innebär en hög grad av risk och kan fluktuera kraftigt. Du bör noga överväga om handel med eller innehav av digitala tillgångar är lämpligt för dig mot bakgrund av din ekonomiska situation.