Kommer ikke til å gjeninnføre @OpenledgerHQ, hvis du har fulgt med, får du allerede visjonen. Hvis du ikke har gjort det, følg opp med innlegget nedenfor 👇

Men her er hva de fleste fortsatt ikke har skjønt:

Dette er ikke bare en "Web3 AI-gård" med gimmicker.

@OpenledgerHQ løser i det stille kjerneproblemet med AI i dag: modelltilpasning med virkelige insentiver.

Tenk på det...

AI i dag er bygget på data hentet fra folk som aldri valgte å delta og aldri fikk betalt.

Og så sender den ut ting du ikke kan revidere, ikke kan spore og definitivt ikke kan tjene penger med mindre du er Big Tech.

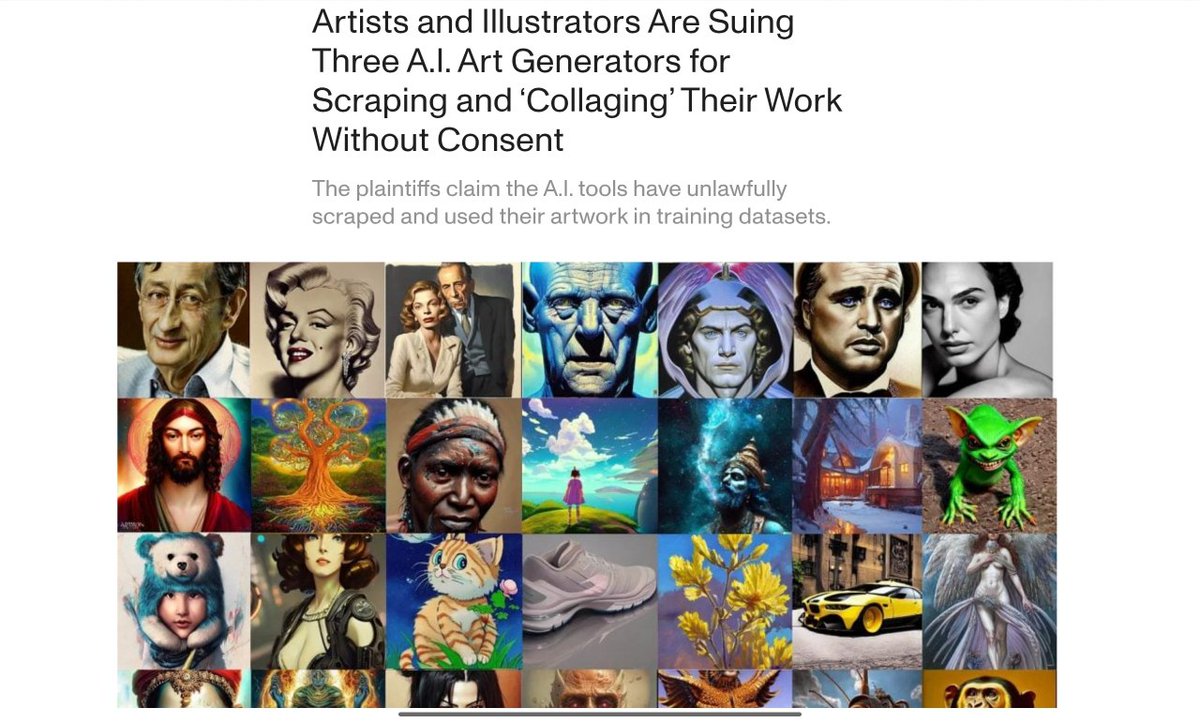

Det er derfor det hver uke er et nytt søksmål, ikke fordi AI er dårlig, men fordi systemet er ødelagt ved kilden.

OpenLedger fikser ikke bare det.

Den bygger en protokoll der:

▸ Attribusjon er standard

▸ Belønninger er automatiske

▸ Og jo mer nyttige dataene dine er, jo mer tjener du

Det GitHub gjorde for åpen kildekode-utviklere, gjør OpenLedger for bidragsytere til åpne data.

Du laster opp, finjusterer, spør eller til og med bare kuraterer.

Systemet håndterer attribusjon, sporer modellbruk og betaler deg.

Alt på kjedet. Ingen mellommenn.

Dette er den delen de fleste sover på > du trenger ikke å være AI-forsker for å delta.

Du kan bygge datasett, lage logikk, optimalisere utdata og fortsatt tjene.

Hvis du bare er her for Kaito- eller Cookie-insentiver, er det greit.

Men den virkelige alfaen?

OpenLedger bygger skinnene for en ny AI-økonomi, en der protokollen vet hvem som bidro med hva, og verdiflyter deretter.

Hvis den neste milliardmodellen trenes på kjede, vil det være fordi dette systemet gjorde det mulig.

Bidrag → attribusjon → belønning.

Det er ikke jordbruk.

Det er grunnlaget.

Vi har fått språkmodeller til å høres ut som magi, men ingen vil snakke om de rotete, hemmelighetsfulle rørledningene under.

Milliarder av datapunkter skrapte. Null ansvarlighet.

Genererte utganger. Ingen kvitteringer.

Og når AI sier noe galt, støtende eller direkte plagiert?

Vi trekker på skuldrene. «Modellen lærte det et sted.»

Problemet har et navn: The Black Box.

Og det begynner å koste oss.

Husker du da kunstnere på tvers av DeviantArt, ArtStation og Behance oppdaget at porteføljene deres ble brukt, uten samtykke, til å trene AI-bildemodeller?

Hele kunststiler kopiert. Signaturer forvrengt. Kommersielle produksjoner som så uhyggelig identiske ut med originale verk.

Tusenvis av skapere sendte inn begjæringer, ble med i gruppesøksmål og krevde regulering.

Spørsmålet deres var enkelt: "Hvor fikk modellen dette fra?"

Men svaret var uklart.

For sannheten er: de fleste AI-selskaper kan ikke forklare hvilke data som formet hvilken produksjon. Opplæringsrørledningene er ugjennomsiktige av design. Ingen logger. Ingen attribusjon. Ikke noe eierskap.

Det er det som bryter tilliten, og kveler ansvarlighet.

Men hva om vi bygde AI annerledes?

Hva om vi kunne spore hvert bidrag, belønne data av høy kvalitet og holde modellene ansvarlige, nedenfra og opp?

Det er oppdraget til @OpenledgerHQ, et desentralisert AI-nettverk der attribusjon er innebygd i selve protokollen.

I kjernen er noe som kalles Proof of Attribution (PoA).

Tenk på det som det motsatte av en svart boks.

PoA sikrer at hver AI-utgang kan spores tilbake til dataene som formet den.

Den kobler kryptografisk treningsdata, modellatferd og bidragsyteridentitet, alt lagret transparent på kjeden.

Dette betyr:

» Du kan bekrefte hvem som har lagt til hvilke data

» Bidragsytere blir belønnet basert på innvirkning

» Ondsinnede inndata eller inndata av lav kvalitet kan straffes

» AI-responser får forklarbarhet, et kritisk skritt for sikkerhet og tillit

Det @OpenledgerHQ testnettet er allerede live, og i motsetning til de fleste er det ikke bare en "demo".

Du kan:

▸ Lag ditt eget datanett

▸ Finjuster eller samhandle med AI-modeller

▸ Spor hvilke data som formet svarene

▸ Gjør krav på belønninger gjennom Yapper-ledertavlen

▸ Ingen GPU- eller ML-erfaring kreves

Alle interaksjoner er på kjeden. Ikke noe mysterium. Ingen magi. Bare ekte, ansvarlig AI.

I en tid da store aktører er låst i milliardsøksmål og offentlig mistillit vokser, bygger OpenLedger noe radikalt annerledes:

> En fremtid der data eies av fellesskapet.

> En fremtid der AI-modeller er åpne, transparente og reviderbare.

> En fremtid der bidragsytere ikke utnyttes, men styrkes.

Så mens andre gjemmer seg bak NDA-er og lukkede vekter, er OpenLedger opptatt med å bevise den nye standarden.

Bare åpne AI, etter design.

Vil du se det i aksjon?

Epoke 2 av testnettet er live.

Ingen portvakt. Ingen GPU. Bare din nysgjerrighet og en lommebok.

ÅPEN HOVEDBOK 🟠

Gjennomsiktig AI. Eid av alle.

1,64k

16

Innholdet på denne siden er levert av tredjeparter. Med mindre annet er oppgitt, er ikke OKX forfatteren av de siterte artikkelen(e) og krever ingen opphavsrett til materialet. Innholdet er kun gitt for informasjonsformål og representerer ikke synspunktene til OKX. Det er ikke ment å være en anbefaling av noe slag og bør ikke betraktes som investeringsråd eller en oppfordring om å kjøpe eller selge digitale aktiva. I den grad generativ AI brukes til å gi sammendrag eller annen informasjon, kan slikt AI-generert innhold være unøyaktig eller inkonsekvent. Vennligst les den koblede artikkelen for mer detaljer og informasjon. OKX er ikke ansvarlig for innhold som er vert på tredjeparts nettsteder. Beholdning av digitale aktiva, inkludert stablecoins og NFT-er, innebærer en høy grad av risiko og kan svinge mye. Du bør nøye vurdere om handel eller innehav av digitale aktiva passer for deg i lys av din økonomiske tilstand.